Agen AI bergerak cepat dari demo yang mengesankan menjadi alat nyata yang bisa bertindak atas nama Anda, dan OpenClaw adalah salah satu nama yang memicu gelombang perhatian terbaru. Anda mungkin pernah mendengar perangkat lunak yang sama disebut Clawdbot atau Moltbot, nama-nama yang digunakan pada berbagai tahap pengembangan oleh penciptanya, pengembang Austria Peter Steinberger.

Dipromosikan sebagai asisten pribadi tanpa perlu intervensi yang bisa mengoperasikan perangkat lunak untuk Anda, OpenClaw juga menimbulkan pertanyaan penting tentang akses dan keamanan.

- Agen AI adalah sistem AI yang mampu bertindak, bukan sekadar alat percakapan.

- Alat seperti OpenClaw memperlihatkan seberapa kuat agen AI yang dijalankan sendiri bisa menjadi.

- Kekuatan ini membuka risiko keamanan baru ketika agen memproses input yang tidak dapat dipercaya.

- Injeksi prompt adalah ancaman utama untuk agen AI, bahkan lebih berbahaya dibanding untuk chatbot.

- Memori persisten dapat memperbesar kesalahan dan memperpanjang serangan.

- Agen AI memang kuat, tetapi bukan pilihan yang aman bagi kebanyakan konsumen secara default.

Apa yang membuat OpenClaw begitu heboh?

OpenClaw mendapat perhatian karena ia menandai pergeseran dari AI yang sekadar menjawab pertanyaan menjadi AI yang benar-benar dapat menjalankan tugas pada sistem nyata dan bahkan menggunakan perangkat lunak. Masalah keamanan potensial inilah yang membuat lebih banyak orang di komunitas keamanan mulai membahas OpenClaw. Lalu apa yang membuat OpenClaw menarik bagi pengembang dan pengguna tingkat lanjut?

OpenClaw menonjol karena ia mampu mengambil tindakan nyata, bukan hanya menghasilkan teks atau saran. Alih-alih memberi tahu Anda apa yang harus dilakukan, ia bisa melakukannya sendiri. Teknologi ini bisa membuka aplikasi, mengirim pesan, memindahkan file, menjalankan perintah, dan berinteraksi langsung dengan sistem atas nama Anda.

Tingkat otomatisasi seperti itu yang menarik perhatian. Pengembang dan pengguna mahir melihat kontrol tingkat sistem sebagai cara untuk mengurangi pekerjaan berulang atau mengotomatisasi alur kerja. Gagasan tentang agen AI yang bisa “mengerjakan tugas” daripada sekadar membantu dari pinggir lapangan cukup menggoda.

Janji kemampuan langsung inilah yang membuat OpenClaw melesat dari proyek niche menjadi topik diskusi yang lebih luas.

Mengapa ini penting lebih dari sekadar soal OpenClaw

OpenClaw memberi contoh nyata tentang pergeseran yang lebih luas menuju agen AI yang benar-benar bertindak, bukan hanya merespons atau memberi saran.

Pertanyaan tentang potensi penyalahgunaan jadi tidak terelakkan ketika teknologi semacam ini berkembang. Apa yang ditunjukkan OpenClaw adalah ke mana arah perkembangan AI. Itu membuatnya relevan jauh melampaui satu proyek dan membuka perdebatan berkelanjutan tentang bagaimana agen-agen ini seharusnya dikendalikan. Bisakah mereka dipercaya?

Apa itu agen AI dan apa yang membedakannya dari alat AI lainnya?

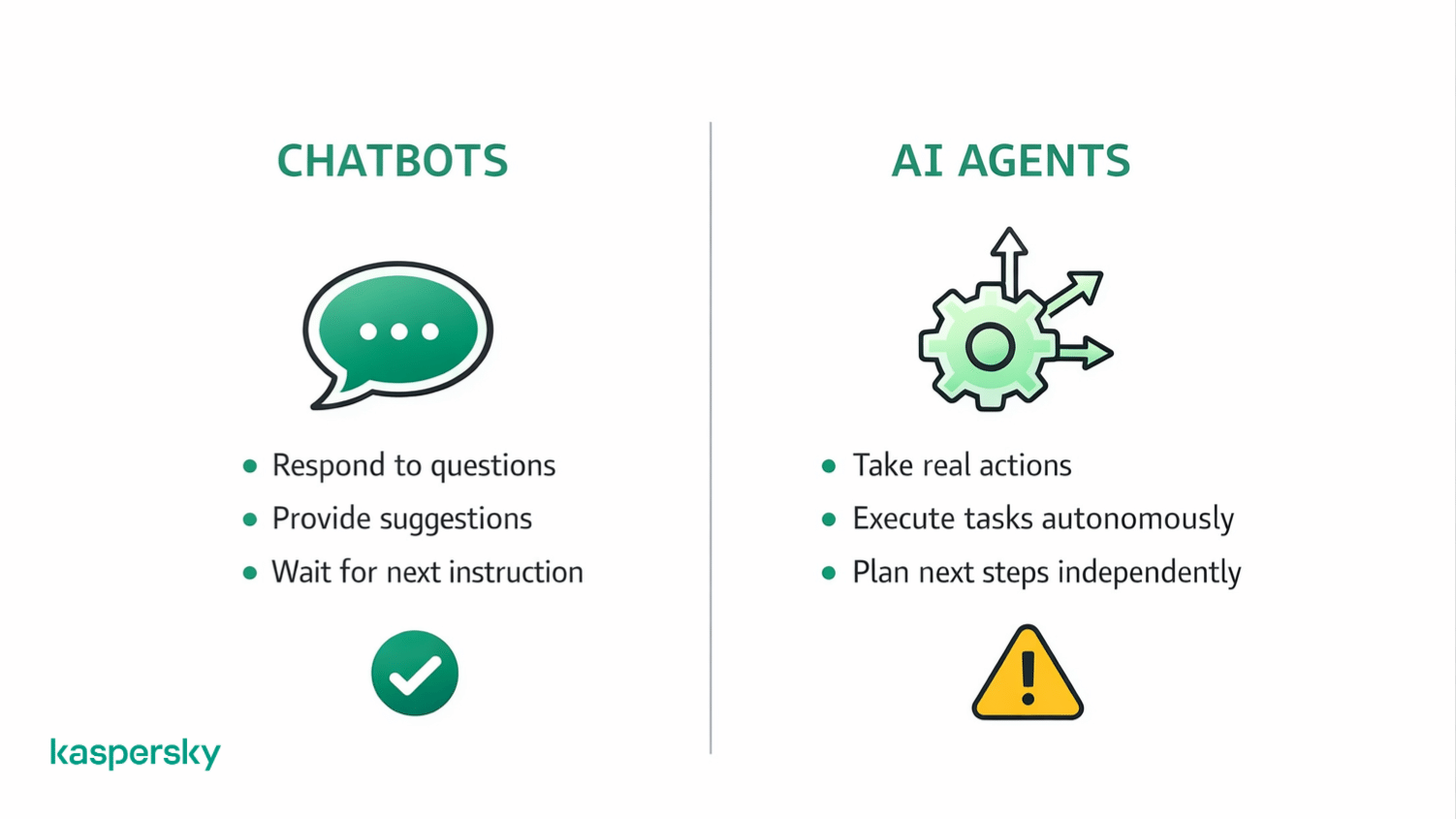

Agen AI adalah sistem yang tidak hanya menyediakan jawaban teks atau audio atas pertanyaan Anda. Mereka dapat merencanakan langkah-langkah dan melaksanakan tindakan untuk mencapai tujuan. Alih-alih berhenti pada saran, mereka memutuskan langkah selanjutnya dan mengeksekusinya.

Seorang agen AI bisa mengamati situasi dan bertindak. Ini berbeda dari sebagian besar alat AI yang merespons prompt tetapi menunggu instruksi berikutnya. Contoh awal termasuk agen-agen pelaksana tugas seperti Manus (sekarang dimiliki oleh Meta). Manus menunjukkan bagaimana agen dapat bergerak dari sekadar chat ke tindakan. Ia bisa menyediakan analisis data atau bahkan menulis kode aktif untuk menyelesaikan masalah tanpa harus diminta secara eksplisit apa yang harus dilakukan. Input manusia menjadi lebih sedikit.

OpenClaw membangun ide yang sama tentang AI yang mampu bertindak, namun menerapkannya dengan cara yang lebih langsung dan kuat.

Apakah OpenClaw hanya agen AI biasa atau sesuatu yang lebih maju?

OpenClaw termasuk dalam kategori agen AI. Namun implementasinya lebih kuat dibanding banyak alat yang saat ini dikenal publik luas.

Alat AI ini bisa merencanakan tugas dan bertindak tanpa input konstan. OpenClaw dapat berinteraksi langsung dengan perangkat lunak dan sistem operasi, bukan hanya dengan API atau alat terbatas. Akses yang lebih luas ini meningkatkan kegunaan dan membuatnya berbeda. Di sisi lain, hal itu juga meningkatkan taruhannya dan memperbesar pentingnya aspek keamanan.

Mengapa agen AI yang dijalankan sendiri berbeda

Agen AI yang dijalankan sendiri berjalan secara lokal di sistem Anda sendiri, bukan pada layanan jarak jauh. Ini memberi pengguna kontrol lebih terhadap hal-hal seperti konfigurasi dan perilaku. Namun kontrol lebih besar juga menggeser tanggung jawab.

Ketika agen memiliki akses lokal, keamanan bergantung pada cara pengaturannya, izin yang diberikan, dan bagaimana pemantauan dilakukan. Kontrol lebih besar membawa risiko yang lebih besar pula.

Proyek-proyek terbaru memperlihatkan bagaimana gagasan agen AI yang dijalankan sendiri mulai berubah. Misalnya, Moltbot (sebelumnya Clawdbot) kini bisa dijalankan menggunakan Moltworker sumber terbuka milik Cloudflare. Ini sepenuhnya menghilangkan kebutuhan perangkat keras lokal khusus dengan menjalankan agen pada platform yang dikelola.

Hal ini menurunkan hambatan masuk dan menyederhanakan pengaturan, tetapi juga memindahkan lokasi kontrol. Ketika agen berjalan di infrastruktur awan, keamanan bergantung tidak hanya pada agen itu sendiri, tetapi juga pada kontrol akses dan cara data serta izin ditangani di seluruh platform.

Misalnya, pengguna bisa saja menghubungkan agen AI ke email mereka dengan harapan agen hanya membaca pesan, sementara pengaturan awan juga mengizinkan agen mengirim email kecuali izin tersebut dimatikan secara eksplisit.

Bagaimana agen AI berbeda dari chatbot seperti ChatGPT?

Chatbot seperti ChatGPT merespons; agen AI bertindak.

Sebuah chatbot dapat memberi saran atau penjelasan. Sebuah agen AI bisa membuka program secara aktif atau menjalankan alur kerja.

Sebagai contoh, beberapa orang menggunakan OpenClaw untuk mengotomatisasi perdagangan. Mereka merancang aturan dan meminta AI bukan hanya memberi saran (yang bisa dilakukan ChatGPT) tetapi benar-benar mengeksekusi transaksi.

Mengapa agen AI membawa risiko keamanan baru?

Seperti dibahas sebelumnya, agen AI mengambil tindakan alih-alih hanya memberi saran. Ini sering kali disertai akses ke file, aplikasi, atau fungsi sistem.

Akses sistem dan otonomi yang diberikan kepada OpenClaw mengubah dampak dan risiko. OpenClaw akan meminta izin untuk berinteraksi dengan perangkat lunak atau melakukan tindakan seperti mengirim email atau mengisi formulir tanpa pengawasan Anda. Ini mengubahnya menjadi variabel yang sulit diprediksi.

Kesalahan atau manipulasi dapat berakibat nyata. Risiko bukan hanya apa yang diperintahkan kepada agen, tetapi juga bagaimana agen menafsirkan instruksi saat melaksanakan tugas.

Mengapa input yang tidak bisa dipercaya adalah masalah inti

Agen AI mengonsumsi sejumlah besar konten eksternal (seperti halaman web dan dokumen) untuk memutuskan langkah berikutnya. Konten itu tidak selalu dapat dipercaya.

Instruksi tidak harus bersifat langsung. Mereka dapat tersembunyi dalam teks atau data yang dibaca agen saat menjalankan tugas. Ini memungkinkan penyerang memengaruhi perilaku agen tanpa pernah berinteraksi langsung dengannya.

Masalah ini menciptakan jalur jelas menuju injeksi prompt — yaitu saat input yang tidak dipercaya digunakan untuk mengarahkan agen agar mengambil tindakan yang tidak semestinya.

Alat AI yang kuat membutuhkan perlindungan lebih ketat

Agen AI dapat mengakses file, email, dan fungsi sistem. Kaspersky Premium membantu mendeteksi aktivitas mencurigakan, memblokir skrip berbahaya, dan melindungi perangkat Anda dari ancaman siber dunia nyata.

Coba Premium GratisApa itu injeksi prompt pada agen AI?

Injeksi prompt adalah cara memanipulasi agen AI dengan memberinya konten eksternal yang tidak dapat dipercaya sehingga mengubah perilakunya.

Risikonya bukan semata-mata cacat teknis pada kode. Masalahnya adalah agen mungkin memperlakukan input eksternal seperti pesan instan atau komentar sebagai instruksi. Ketika itu terjadi, agen bisa diarahkan untuk mengambil tindakan yang seharusnya tidak dilakukan.

Bagaimana injeksi prompt bekerja di skenario nyata

Injeksi prompt bisa bersifat langsung atau tidak langsung.

- Langsung – penyerang sengaja menyisipkan instruksi ke dalam konten yang dibaca agen.

- Tidak langsung – agen menangkap instruksi tersembunyi atau tak terduga dari situs web atau pesan yang diprosesnya saat menangani tugas normal.

Masalah utamanya adalah perilaku. Agen mungkin mengikuti apa yang diinterpretasikannya sebagai panduan, meskipun panduan itu datang dari sumber yang tidak dapat dipercaya. Tidak perlu ada bug perangkat lunak klasik agar ini terjadi.

Mengapa injeksi prompt lebih berbahaya untuk agen AI dibanding chatbot

Instruksi yang disisipkan biasanya memengaruhi respons dan saran yang diberikan oleh chatbot. Pada agen AI, instruksi itu bisa memengaruhi tindakan nyata.

Jika agen memiliki akses ke file atau kontrol sistem, instruksi yang dimanipulasi dapat menyebabkan perubahan nyata di dunia nyata. Karena itulah injeksi prompt menimbulkan risiko lebih besar untuk agen. Teknik yang sama yang mengubah keluaran teks pada chatbot dapat memicu tindakan tidak diinginkan ketika agen yang terlibat memiliki kemampuan eksekusi.

Apa itu memori persisten pada agen AI?

Memori persisten memungkinkan agen AI menyimpan informasi dari waktu ke waktu. Artinya, agen bisa menggunakan input sebelumnya untuk mengarahkan keputusan di masa depan alih-alih memulai dari awal setiap kali menangani tugas.

Apa arti memori persisten untuk agen AI

Agen AI dapat menyimpan konteks dan instruksi antar sesi serta mengembangkan ‘perilaku’ yang disukai. Ini membantu agen bekerja lebih efisien dengan mengingat apa yang pernah dipelajarinya atau dilakukan sebelumnya.

Hal ini juga berarti input sebelumnya dapat memengaruhi perilaku di kemudian hari. Instruksi atau asumsi yang diperoleh pada tugas terdahulu mungkin masih membentuk cara agen bertindak pada situasi berbeda, bahkan jika pengguna tidak lagi menyadarinya.

Mengapa memori persisten meningkatkan risiko keamanan

Memori persisten dapat memperkenalkan efek tertunda. Instruksi berbahaya mungkin tidak menimbulkan masalah segera tetapi bisa muncul kembali nanti ketika kondisi memungkinkan.

Ini membuat pembersihan lebih sulit. Perilaku tersimpan bisa berulang di berbagai tugas. Mengembalikan agen ke kondisi semula seringkali memerlukan pengosongan memori atau membangun ulang konfigurasi untuk memastikan pengaruh yang tidak diinginkan hilang.

Apa yang terjadi jika agen AI salah konfigurasi atau terekspos?

Agen AI dapat diakses atau dipengaruhi dengan cara yang tidak diinginkan pemiliknya, mengubah alat yang tadinya membantu menjadi risiko keamanan potensial.

Ini bisa terjadi karena kecelakaan atau salah paham. Bisa juga terjadi jika pihak ketiga mencoba memanipulasi agen.

Bagaimana agen AI bisa terekspos tanpa sengaja

Pemaparan sering terjadi karena kesalahan sederhana. Sesuatu sekecil otentikasi yang lemah atau izin yang terlalu luas bisa membuat agen dapat dijangkau dari luar lingkungan yang dimaksudkan.

Menjalankan agen secara lokal tidak otomatis membuatnya aman. Jika agen terhubung ke internet atau berinteraksi dengan sistem lain, maka ia bisa dipengaruhi. Kontrol lokal memang mengurangi beberapa risiko, tetapi bukan jaminan keamanan mutlak.

Mengapa agen AI yang terekspos menjadi permukaan serangan

Setelah terekspos, agen AI menjadi sesuatu yang dapat diuji, dicoba, dan dimanipulasi oleh penyerang. Mereka mungkin mencoba memberi input yang dirancang khusus, memicu tindakan, atau mempelajari bagaimana agen berperilaku seiring waktu.

Karena agen dapat mengambil tindakan nyata, penyalahgunaan tidak harus tampak seperti peretasan tradisional. Penyalahgunaan bisa melibatkan pengendalian perilaku, pengambilan data, atau menyebabkan perubahan sistem yang tidak diinginkan — semuanya tanpa mengeksploitasi celah perangkat lunak klasik.

Apa itu “trinitas mematikan” dalam keamanan agen AI?

“Trinitas mematikan” menggambarkan tiga kondisi yang bila terjadi bersama-sama menciptakan risiko keamanan serius untuk agen AI.

Tiga kondisi yang memungkinkan serangan serius

- Kondisi pertama adalah akses ke data sensitif, seperti file, kredensial, atau informasi internal.

- Kondisi kedua adalah input yang tidak dapat dipercaya, yang berarti agen mengonsumsi konten yang tidak bisa diverifikasi sepenuhnya.

- Kondisi ketiga adalah kemampuan melakukan tindakan eksternal, seperti mengirim permintaan, memodifikasi sistem, atau mengeksekusi perintah.

Secara terpisah, faktor-faktor ini bisa dikelola. Mereka menjadi berbahaya ketika membentuk trinitas ini. Agen yang membaca input yang tidak dapat dipercaya dan bisa bertindak atasnya membuka jalur yang jelas bagi manipulasi. Mengontrol tindakan apa yang boleh dilakukan agen adalah hal yang sangat penting.

Haruskah pengguna sehari-hari menjalankan agen AI hari ini?

Bagi kebanyakan orang, agen AI masih termasuk alat eksperimental. Mereka bisa berguna dalam pengaturan yang tepat. Namun sisi negatifnya? Mereka juga membawa risiko baru yang tidak selalu jelas.

Kapan menggunakan agen AI masuk akal

Agen AI masuk akal dalam skenario terkontrol dan berisiko rendah. Ini termasuk bereksperimen pada perangkat terpisah. Beberapa orang menjalankan agen yang hanya menangani tugas non-sensitif seperti mengatur file atau menguji alur kerja.

Misalnya, jika Anda ingin menggunakan agen untuk membuat rencana perjalanan, agen tersebut bisa mengakses informasi yang diperlukan dan dibatasi agar tidak bisa menghubungi orang lain secara langsung atau melakukan hal yang terlalu merugikan.

Jika Anda nyaman mengelola pengaturan dan kesalahan yang terjadi tidak memiliki konsekuensi besar, agen bisa menjadi alat pembelajaran. Kuncinya adalah menjaga ruang lingkup kecil dan membatasi akses secara ketat.

Kapan agen AI bukan ide bagus

Agen AI bukan pilihan yang baik ketika mereka memiliki akses ke data sensitif atau akun penting. Menjalankan agen tanpa memahami izin atau bahaya dari input eksternal bisa dengan cepat meningkatkan risiko.

Memutuskan untuk tidak menggunakan agen AI hari ini adalah keputusan yang masuk akal jika kemudahan penggunaan mengorbankan keamanan atau ketenangan pikiran.

Langkah pengamanan dasar apa yang penting saat menggunakan agen AI?

Langkah pengamanan dasar membantu mengurangi risiko dan mencegah kesalahan menjadi masalah serius.

Perangkat lunak Kaspersky dapat menambah lapisan perlindungan dengan menandai perilaku mencurigakan dan membantu melindungi akun dari kebocoran. Paket kami memblokir segala sesuatu mulai dari malware dan virus, hingga ransomware dan aplikasi mata-mata.

Tindakan keselamatan apa yang paling penting

Isolasi adalah kunci. Jalankan agen pada perangkat dan akun terpisah kapan pun memungkinkan agar mereka tidak memengaruhi data atau sistem penting. Batasi izin hanya pada yang benar-benar dibutuhkan agen. Kami menyarankan agar Anda tidak memberikan akses penuh ke sistem atau akun sebagai pengaturan default.

Langkah persetujuan juga penting. Memerlukan konfirmasi sebelum tindakan sensitif menambah jeda yang dapat mencegah perilaku tidak disengaja seperti menyetujui pengeluaran atas nama Anda. Kontrol sederhana ini berdampak besar tanpa menambah kompleksitas berarti.

Apa arti agen AI bagi masa depan AI konsumen?

Agen AI mengarah ke masa depan di mana alat-alat AI melakukan lebih dari sekadar membantu. Mereka bertindak. Namun pergeseran itu datang dengan konsekuensi yang harus mulai dipahami oleh konsumen.

Apa yang dikatakan momen ini tentang kematangan agen AI

Agen AI kuat tetapi belum matang. Mereka bisa mengotomatisasi tugas, namun masih kesulitan dalam beberapa aspek penilaian dan keamanan. Ini bukan berarti agen tidak akan menjadi lebih aman atau andal di masa depan. Tetapi harapan harus realistis.

Agen AI memperlihatkan ke mana arah perkembangan, namun penggunaan luas dalam kehidupan sehari-hari akan membutuhkan perlindungan yang lebih baik dan alat yang dirancang dengan prinsip keselamatan dari awal.

Artikel terkait:

- Bagaimana ChatGPT menangani kekhawatiran keamanan siber dan potensi risikonya?

- Apa risiko kejahatan siber berbasis AI di lanskap digital saat ini?

- Bagaimana AI dan Machine Learning meningkatkan langkah‑langkah keamanan siber?

- Apa bahaya teknologi Deepfake saat ini?

Produk yang direkomendasikan:

FAQs

Apakah OpenClaw bisa diunduh gratis?

OpenClaw dapat diunduh secara gratis di GitHub. Ini adalah perangkat lunak sumber terbuka. Artinya, siapa pun memiliki lebih banyak kebebasan untuk mengubah dan mendistribusikan kembali perangkat lunak tersebut.

Apakah OpenClaw mudah dipasang?

Ada tutorial yang memungkinkan orang menjalankan bot dengan cepat, tetapi pengaturan yang lebih canggih membutuhkan waktu dan pengetahuan khusus. Justru karena itu menjalankan perangkat lunak yang mungkin belum disiapkan dengan benar membawa risiko.